Hola a todos los amantes de internet, los expertos en memes y los que, simplemente, están aquí para reír un rato. Hoy no hablaremos de gatos haciendo cosas graciosas, ni de retos virales de baile (por suerte o por desgracia). Hoy ponemos el foco en algo que nos está quitando la sonrisa a más de uno, y no precisamente por un chiste malo: la Inteligencia Artificial que genera videos. Sí, esa que nos prometía un futuro de películas hechas en casa y videollamadas con avatares perfectos. Pues resulta que también tiene un lado oscuro, más oscuro que el café de primera hora de la mañana cuando lo has dejado enfriar demasiado.

Últimamente, vemos cómo la IA, en lugar de ser una herramienta para la creatividad que nos haría exclamar “¡Qué genio!”, se está convirtiendo en el martillo de quienes confunden “humor” con “falta de respeto” y “sátira” con “estigma social”. ¿Es que no hay límite? ¿Estamos riendo CON la gente o DE la gente? Y, lo que es peor, ¿lo estamos haciendo de una manera que daña, que degrada, y que a veces, incluso, es delictiva?

El Desfile de la Vergüenza: ¡Cuidado con lo que Ves!

¿Preparados para un desfile no precisamente de moda, sino de vergüenza ajena? Aquí te dejo algunos ejemplos de videos “creados con IA” que circulan por ahí y que, francamente, deberían hacernos reflexionar. Y sí, también cabrearnos un poco. ¡Atención, porque el “humor” aquí es más bien un insulto disfrazado!

El “Cómico” Racista de TikTok: Cuando el Estereotipo Duele

¿Viste esa noticia que dio la vuelta a la red el 4 de julio pasado? El diario “La Vanguardia” lo dejaba bien claro: “Vídeos racistas creados con la IA Veo 3 de Google inundan TikTok”. Sí, amigos, con la Inteligencia Artificial de una de las empresas más grandes del mundo, algunos “creadores” toman la cara de una persona de una etnia concreta y la distorsionan para que parezca que está “robando” algo, o le ponen voz de “gánster” de caricatura. ¿El “chiste”? Que supuestamente “son así”.

¿Por qué esto no tiene ni pizca de gracia? Porque no solo perpetúa estereotipos dañinos y racistas que han costado siglos de lucha erradicar, sino que deshumaniza a las personas. Las reduce a caricaturas ofensivas, y eso, señores y señoras, no es humor. Es odio.

“El humor nunca debería basarse en la denigración de una raza o un colectivo.“

El “Gracioso” de YouTube con la Diversidad Funcional: Una Burla Inaceptable

Imagina un video generado por IA donde se simula a una persona con una discapacidad, exagerando sus movimientos o su habla para crear un efecto “cómico” grotesco. Eso es ensañarse con una condición.

¿Por qué es malo? Porque se burla de la condición de personas que a menudo se enfrentan a barreras reales y discriminación. No hay nada de gracioso en ridiculizar a alguien por su diversidad funcional. Es un ataque directo a su dignidad y a los esfuerzos que hacemos por construir una sociedad inclusiva y respetuosa.

Instagram y la Misoginia Digital: Cuando el “Deepfake” es una Agresión

Quizás te has topado con contenido generado por IA donde las mujeres son presentadas como objetos, o en roles sumisas y estúpidas, todo bajo la excusa del “humor” machista. O peor aún, deepfakes no consentidos con fines sexuales. Sí, la Fiscalía en España ya está investigando casos de este tipo, como la creación de videos sexuales falsos con menores, una realidad que nos revuelve el estómago. Puedes leerlo aquí:

¿Por qué es malo? Refuerza la misoginia, la objetivación de la mujer y el acoso en línea. Este tipo de contenido contribuye a una cultura que normaliza el maltrato y la falta de respeto, y en sus peores formas, es una agresión sexual en toda regla.

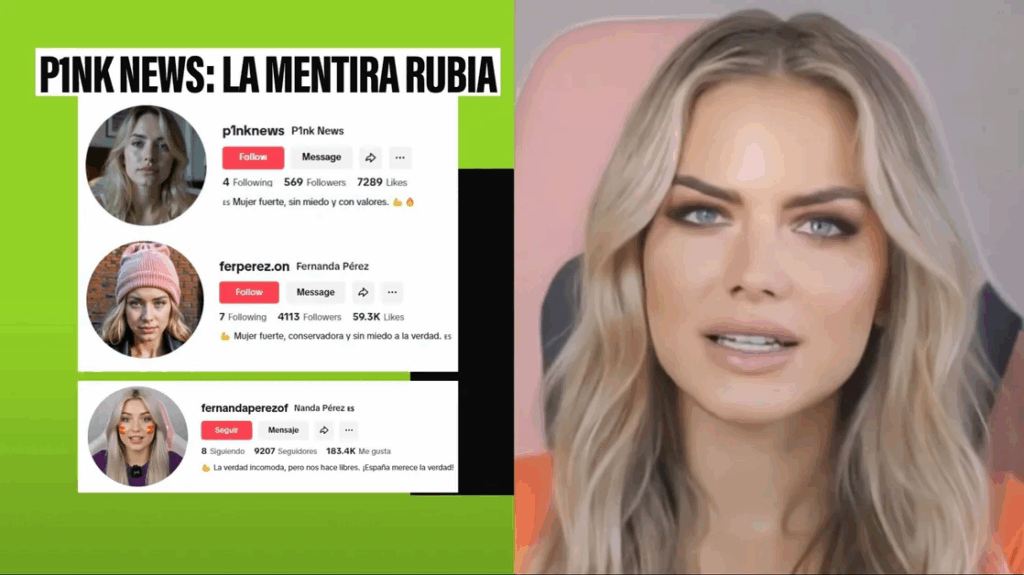

Facebook: El “Periodista” de la Desinformación (con un toque de IA)

¿Has notado cómo de repente un político o una figura pública parece decir cosas que nunca dijo, o aparece en un contexto totalmente falso para crear una narrativa de odio o desinformación? Con la IA, esto es más fácil que nunca. En España, en cada ciclo electoral, los fact-checkers como Verificat y Maldita.es se ponen las pilas para combatir la desinformación que circula como la pólvora. Lo hacen revisando miles de contenidos, muchos de ellos visuales. Puedes ver el trabajo que hacen aquí:

¿Por qué es malo? Socava la confianza en la información, genera polarización social y puede, literalmente, incitar a la violencia contra grupos vulnerables. Cuando la IA se pone al servicio de fabricar “realidades” falsas, el daño a la democracia y a la convivencia es, sencillamente, incalculable.

¡Alerta Máxima! La IA y el Ciberacoso Infantil: Cuando la Broma se Convierte en Pesadilla

Si todo lo anterior ya te revolvía el estómago, prepárate, porque hay un uso de la IA que es, simplemente, imperdonable: el ciberacoso a nuestros niños y adolescentes. Estamos viendo cómo la Inteligencia Artificial se está utilizando para crear videos de compañeros y compañeras, poniendo sus caras en situaciones horribles: desde escenas íntimas y sexuales sin su consentimiento (¡sí, deepfakes pornográficos infantiles, una auténtica barbarie!) hasta simulaciones de violencia, bullying o humillaciones que nunca ocurrieron.

En España, proyectos como PRECISION, impulsado por la Universitat Politècnica de València, han detectado un aumento alarmante en la transmisión digital de material de abuso sexual infantil. Más información:

La mala praxis aquí no es una broma; es un delito, una agresión directa a la dignidad, la privacidad y la salud mental de los más vulnerables. Imagina el daño psicológico que sufre un niño o adolescente cuando ve su cara en un video así, difundido entre sus amigos o por internet. Es una cicatriz que puede durar toda la vida, generando ansiedad, vergüenza extrema, depresión e, incluso, en los casos más trágicos, pensamientos suicidas.

¿Por qué es malo? Porque es abuso. Es una forma de violencia digital que aprovecha la tecnología para destrozar vidas jóvenes.

“No hay ‘humor’ posible cuando se destruye la infancia. Esto es abuso, y hay que ser implacables.”

¿Dónde está el botón de “Apagar la Indignación”? La Ley, las Plataformas y la Responsabilidad de Todos

La tecnología es una herramienta. Un martillo puede construir una casa o destrozarla. La IA para generar video no es la excepción. El problema no es la IA en sí, sino el uso pervertido que algunos le están dando. Entonces, ¿qué se está haciendo y qué podemos hacer nosotros, aquí en España?

- Desde la Ley y la Regulación: Europa y España hacen los deberes (o lo intentan)

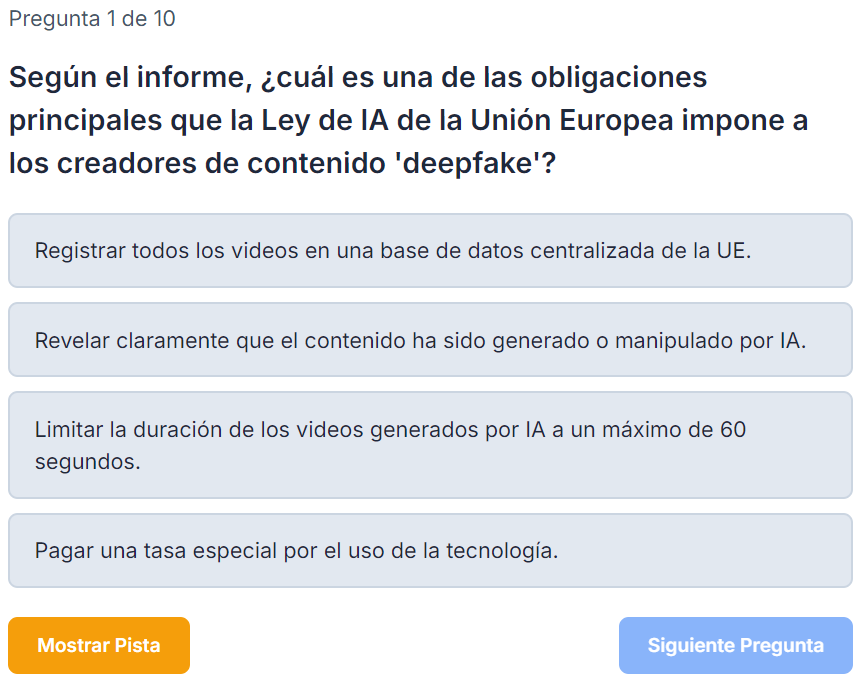

- ¡La Ley de IA de la UE, ya en marcha! Europa ha dado un paso de gigante con su Ley de Inteligencia Artificial, publicada oficialmente el 12 de julio de 2024. Esta ley no es una broma: exige que el contenido generado por IA, especialmente los deepfakes, se etiquete claramente. Y lo que es más importante, prohíbe directamente ciertos usos de la IA considerados de alto riesgo o que atentan contra los derechos fundamentales. ¡Un soplo de aire fresco en un mundo digital que a veces parece tierra de nadie! Puedes consultar los detalles aquí: BioID – EU AI Act Deepfake Regulations Explained y el texto oficial en el Diario Oficial de la Unión Europea.

- España se pone seria con los menores: El gobierno español ha impulsado una nueva Ley Orgánica que criminaliza el uso de la IA para crear deepfakes sexuales o vejatorios, con penas de prisión. Además, obliga a las plataformas a poner sistemas de verificación de edad y etiquetar contenidos peligrosos. ¿El objetivo? Que España sea un referente en la protección digital de los más pequeños. Más información: Tecnolawyer – Revolución Legal: Nuevas medidas contra el abuso digital infantil.

- Las agencias están ahí: Organismos como la Agencia Española de Protección de Datos (AEPD) trabajan arduamente analizando la IA y sus impactos en la privacidad y los derechos fundamentales. Son una especie de “centinelas” digitales. Más sobre su trabajo: AEPD – Inteligencia Artificial.

- La Responsabilidad de las Plataformas (como TikTok, YouTube, Instagram, Facebook): ¡Ahora sí que toca moverse!

Las grandes redes sociales no pueden lavarse las manos. Están obligadas a actuar contra el contenido dañino generado por IA, y muchas ya están implementando medidas:

- TikTok: Exige a los creadores etiquetar el contenido generado por IA si es realista. Y ojo, prohíbe explícitamente los deepfakes de menores, figuras públicas sin consentimiento o recreaciones de momentos de crisis. Todos los detalles: TikTok Support – AI-generated content policy.

- YouTube: Requiere a los creadores divulgar el contenido “significativamente alterado o generado sintéticamente”. Aplica etiquetas visibles y puede penalizar si no se divulga. También tiene políticas estrictas contra la desinformación peligrosa. Míralo aquí: YouTube Help – Content made with AI or other synthetic media.

- Facebook e Instagram (Meta): Añaden etiquetas “AI info” al contenido generado o modificado por IA. Colaboran con verificadores de hechos y eliminan deepfakes engañosos y desinformación que incite a la violencia o interfiera en procesos electorales. ¡Se están poniendo las pilas en la detección con IA! Puedes leerlo aquí: Meta – Expanding Meta’s Labels for AI-Generated Content y su Política de contenido generado con IA.

- Tu Fuerza es Clave: ¿Qué podemos hacer como Usuarios, Familias y Educadores?

La tecnología está aquí, y la mejor defensa es una buena educación y una actitud proactiva.

- ¡Alerta, Usuarios! Sé tu propio detector de “fake humor”: Sé crítico con la información que consumes y compartes. Aprende a identificar las señales de los deepfakes y la desinformación (inconsistencias visuales/auditivas, expresiones faciales antinaturales, fuentes no fiables…). ¡Tu intuición es tu mejor aliada!

- ¡Educa, Sociedad! La conversación en casa es vital: Hablemos con nuestros hijos, amigos, familiares. Enseñemos a discernir, a respetar, a entender que el “humor” que daña no es humor, es agresión. En España, hay iniciativas geniales como las de Fundesplai, que promueven la alfabetización digital con proyectos de concienciación sobre la IA (como “GlosarIA”) Conócelos aquí: Fundesplai – GlosarIA.

- ¡Protege a Nuestros Menores! Su seguridad es la prioridad absoluta: Habla con los niños y adolescentes sobre estos riesgos. Enséñales a NO crear, NO compartir y NO visualizar contenido que denigre a nadie, y menos si implica la imagen de otros menores. Explícales cómo denunciar. ¡Esta es nuestra barrera más importante!

- ¡Denuncia Sin Miedo! ¡No calles, actúa!: Si ves este tipo de contenido (especialmente si afecta a menores), DENÚNCIALO inmediatamente a la plataforma y, si es grave, a las autoridades competentes (Policía Nacional, Guardia Civil). La Policía Nacional y la Guardia Civil tienen canales específicos para delitos tecnológicos. Y recuerda el 017 de INCIBE (Instituto Nacional de Ciberseguridad), su línea de ayuda gratuita para ciberseguridad, que te orientará sobre cómo actuar Todos los recursos: INCIBE – 017 Línea de Ayuda en Ciberseguridad. ¡No mirar hacia otro lado es crucial. Cada denuncia suma!

Taller Recomendado: “Narrativas Digitales con IA: De la Idea al Video (con Conciencia)”

| Porque no todo tiene que ser drama, proponemos un taller práctico y divulgativo para adultos. ¿El objetivo? Aprender a usar las herramientas de IA generativa de video que tenemos al alcance… ¡pero con cabeza, con conciencia y con ética! ¿Quién puede venir? Adultos, educadores, comunicadores, padres y madres, y cualquier persona con ganas de entender y experimentar con la IA de manera responsable. ¿Qué haremos? 1. Desmontando la IA de Video: Una introducción divertida y clara a cómo funciona esta magia. 2. Las Herramientas al Microscopio (¡y en tus manos!): Te mostraremos y haremos pruebas con herramientas “user-friendly” como Synthesia o Pictory (ideales para hacer videos a partir de texto con avatares), y Fliki o VEED.IO (para convertir texto en video y audio). ¡Verás que crear con IA es más fácil de lo que parece! 3. El Plato Fuerte: Ética en la Creación con IA: Aquí es donde nos pondremos serios (¡pero sin aburrir!). Hablaremos de transparencia, consentimiento, no-discriminación, privacidad. Discutiremos casos de deepfakes y cómo evitar caer en la desinformación. Una parte vital para no contribuir al “fake humor”. 4. Creando en Positivo: Exploraremos las mil y una maneras de usar la IA para proyectos educativos, divulgativos o culturales. 5. Defensa Digital 101: Repasaremos los mecanismos para denunciar contenidos dañinos en las plataformas y quién nos puede ayudar (INCIBE 017, autoridades). ¿Qué te llevarás? Conocimiento práctico para crear videos con IA y, fundamentalmente, una brújula ética para navegar por el mundo digital sin perder el norte. |

El Futuro Próximo: La IA y el Reino de los Medios (Cine, TV, Consolas, Redes…)

La IA generativa de video no es una burbuja, es un tsunami que ya está cambiando el paisaje audiovisual.

- Cine y TV: Hollywood ya está temblando (y abrazándola)

Imagina escenas de películas complejas, efectos especiales hiperrealistas o incluso la “resurrección” de actores con IA, todo esto reduciendo costes y tiempos de producción. Las huelgas recientes de actores y guionistas en Hollywood ya han puesto la IA sobre la mesa. La preproducción (los storyboards, las previsualizaciones) ya se está optimizando con IA. Pero, ¿cuál es la autenticidad? ¿Cuáles son los derechos de imagen? La conversación apenas comienza. - Videojuegos: Más mundos, más inmersión

La IA ya es clave en el diseño de personajes, la generación de mundos abiertos gigantes y las narraciones dinámicas. El Consell de l’Audiovisual de Catalunya (CAC) ha destacado en sus informes que la IA generativa puede reducir costes de producción y permitir la creación de contenido por los propios usuarios (user-generated content), abriendo nuevas vías para contar historias. Más detalles en los informes del CAC sobre el audiovisual: CAC – Informe audiovisual 2023. - Consolas y Realidad Virtual/Aumentada (RV/RA): La realidad se multiplica (y confunde)

La IA puede crear entornos virtuales inmersivos e interactivos de una manera más rápida y eficiente, difuminando las líneas entre lo que es real y lo que es virtual. Las experiencias de RV/RA serán más ricas, personalizadas y, a veces, inquietantemente realistas. - Redes Sociales: Un océano de videos (y de responsabilidad)

Más allá de lo que ya vemos, la capacidad de crear videos personalizados y ultra-convincentes para publicidad, marketing de influencia y comunicación personal se multiplicará exponencialmente. Esto requerirá un ojo aún más crítico por nuestra parte y una legislación cada vez más robusta. Pero también hay espacio para proyectos positivos: en SantBoi.Tv, por ejemplo, ya exploran el uso de IA generativa de código abierto para democratizar la creación de contenido multimedia, con un toque local y consciente. Descúbrelo aquí: SantBoi.Tv – Etiqueta AIG.

En resumen: ¡La diversión sí, la degradación no! Exigimos a las plataformas, a los creadores y a nosotros mismos un uso de la IA que construya, no que destruya. Que nos haga reír por la genialidad y la creatividad, no por el dolor ajeno.

“¡Tu conciencia es tu mejor detector de ‘fake humor’!”

La Doble Cara de la IA

La generación de video con Inteligencia Artificial abre un mundo de creatividad, pero también una caja de Pandora de graves riesgos. Esta es la realidad en España.

El Desfile de la Vergüenza: Usos Nocivos

Racismo y Odio

Uso de la IA para crear contenido que perpetúa estereotipos y deshumaniza colectivos, aprovechándose de prejuicios existentes.

Misoginia Digital

Creación de *deepfakes* sexuales no consentidos y contenido que objetiva a las mujeres, constituyendo una forma de agresión digital.

Desinformación

Fabricación de noticias falsas y videos manipulados de figuras públicas para polarizar y minar la confianza democrática.

Burla y Estigma

Ridiculización de personas con diversidad funcional u otros colectivos, atacando directamente su dignidad.

La Epidemia de la Desinformación

La capacidad de la IA para crear contenido falso realista es uno de los mayores desafíos. Muchos jóvenes, que se informan principalmente a través de redes sociales, tienen dificultades para distinguir la verdad de la mentira.

Un 40% de las afirmaciones en debates electorales en España requerían matices o eran directamente falsas, según verificadores.

Dificultad de los adolescentes para identificar noticias falsas.

ALERTA MÁXIMA

El uso más grave de la IA es el ciberacoso contra menores, creando contenido íntimo o violento que causa un daño psicológico irreparable.

87%

de incremento en la transmisión de material de abuso sexual infantil desde 2019.

52%

de aumento del ciberacoso contra menores en España desde 2017.

75%

de los menores afectados nunca lo cuenta a sus padres, dificultando la intervención.

El Silencio que Duele

La mayoría de menores que sufren ciberacoso no lo comunican, a menudo por miedo o vergüenza. Este gráfico muestra el porcentaje de víctimas que no comparten su sufrimiento con nadie.

Construyendo un Muro de Contención: Marco de Respuesta

La lucha contra el uso nocivo de la IA requiere una acción coordinada a todos los niveles, desde leyes europeas hasta nuestra responsabilidad individual.

NIVEL 1: Marco Legal Supranacional

La Ley de IA de la UE establece obligaciones de transparencia, exigiendo etiquetar los *deepfakes* para evitar engaños.

NIVEL 2: Legislación Nacional

Ley de Protección de Menores en España: Penaliza la creación de *deepfakes* sexuales y obliga a incluir controles parentales.

NIVEL 3: Políticas de Plataformas

TikTok, YouTube, Meta (Facebook/Instagram): Implementan el etiquetado obligatorio de contenido IA y mecanismos de denuncia rápidos. Colaboran con verificadores.

NIVEL 4: Acción Ciudadana (TU PAPEL)

Educación y Pensamiento Crítico: Cuestiona, contrasta y verifica la información antes de compartirla.

Denuncia Activa: Utiliza las herramientas de las plataformas para reportar contenido nocivo.

![SantBoi[.Tv]ai](https://santboi.tv/wp-content/uploads/2024/09/LogoStBoi.TvAi_.png)